BERT: Difference between revisions

From CS Wiki

(새 문서: 분류:인공지능 ;Bidirectional Encoder Representations from Transformers ;자연어 처리 언어 모델 == 구분 == === 규칙/지식 기반 접근법 === ;Symbolic App...) |

No edit summary |

||

| (3 intermediate revisions by the same user not shown) | |||

| Line 3: | Line 3: | ||

;[[자연어 처리]] 언어 모델 | ;[[자연어 처리]] 언어 모델 | ||

[[파일:BERT 아키텍처.jpeg|500px]] | |||

== | == 특징 == | ||

* RNN을 사용하지 않는 Attention 모델 | |||

* | * 장점 | ||

** 언어 이해의 우수성 | |||

* 단점 | |||

** 계산 cost가 매우 큰 모델 | |||

== | === 활성화 함수 === | ||

* | ;ReLU 보다 부드러운 형태인 GELU 적용 | ||

* 음수에 대한 미분이 가능 | |||

[[파일:GELU.png|300px]] | |||

== 주요 기술 == | |||

* WordPiece tokenizing | |||

** 접두사, 접미사를 구분 | |||

** ex) playing, coming, loving → ##ing | |||

** ex) 서울특별시, 세종특별시, 성남시, 안양시 → ##특별시, ##시 | |||

* Multi-Head Attention | |||

* Masked Attention | |||

Latest revision as of 02:43, 30 December 2019

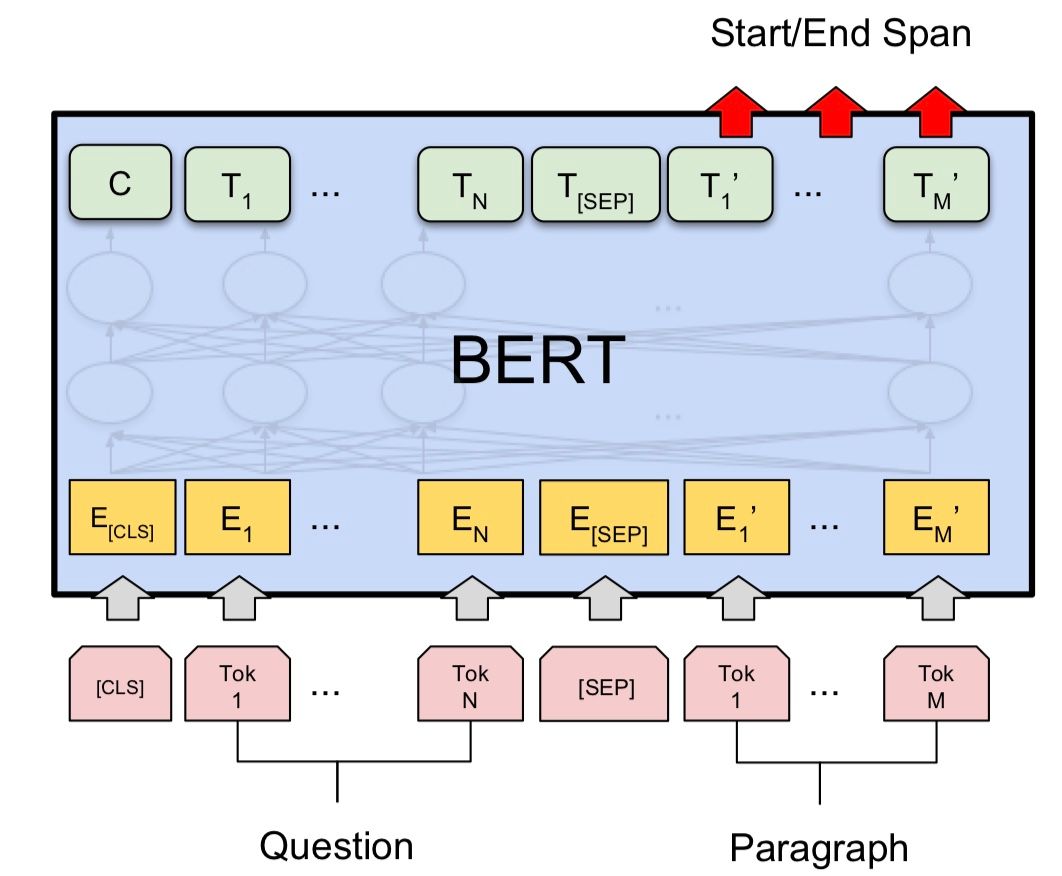

- Bidirectional Encoder Representations from Transformers

- 자연어 처리 언어 모델

특징[edit | edit source]

- RNN을 사용하지 않는 Attention 모델

- 장점

- 언어 이해의 우수성

- 단점

- 계산 cost가 매우 큰 모델

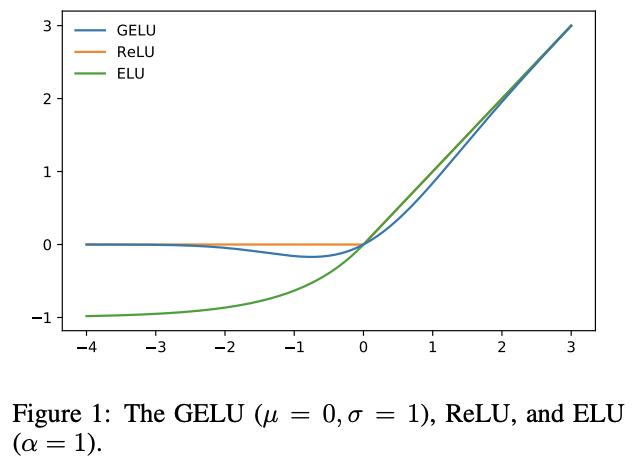

활성화 함수[edit | edit source]

- ReLU 보다 부드러운 형태인 GELU 적용

- 음수에 대한 미분이 가능

주요 기술[edit | edit source]

- WordPiece tokenizing

- 접두사, 접미사를 구분

- ex) playing, coming, loving → ##ing

- ex) 서울특별시, 세종특별시, 성남시, 안양시 → ##특별시, ##시

- Multi-Head Attention

- Masked Attention